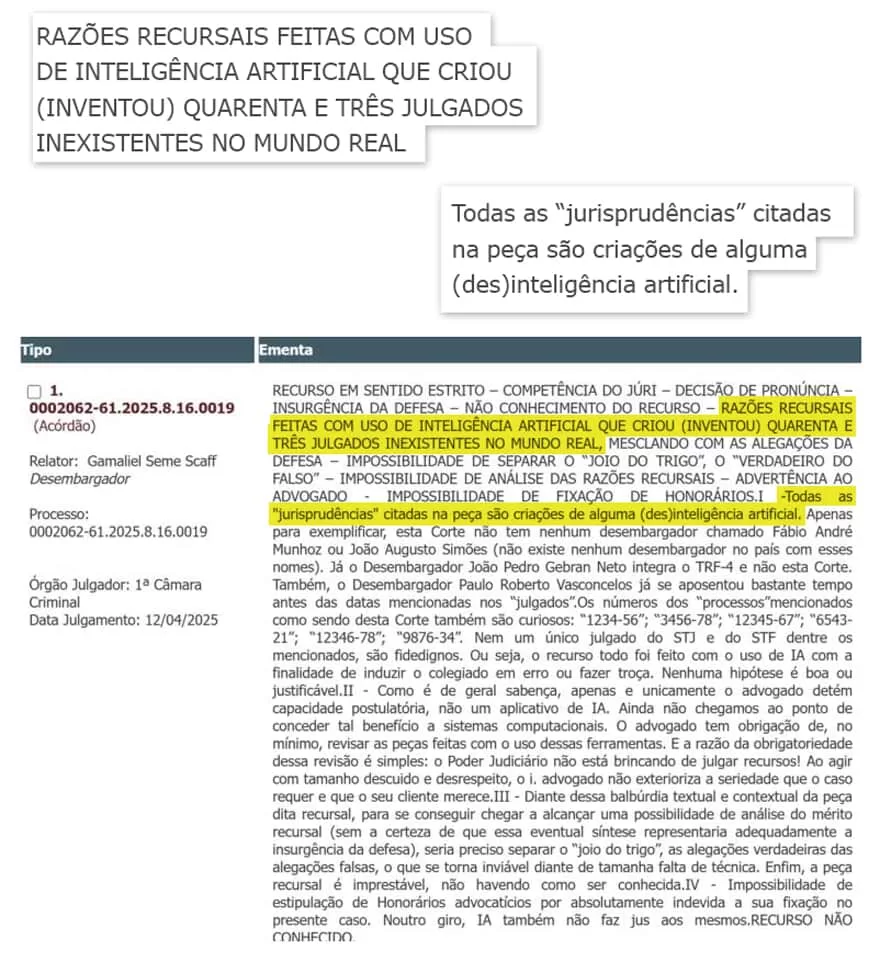

A inteligência artificial está transformando o Direito. Mas, como toda ferramenta poderosa, seu uso exige cuidado, responsabilidade e — acima de tudo — ética. Um exemplo emblemático veio recentemente do Tribunal de Justiça do Paraná (TJ/PR), que recusou um recurso criminal elaborado com IA por conter nada menos que 43 jurisprudências falsas, além de nomes inventados de magistrados e números irreais de processos, conforme matéria publicada no portal migalhas.

Processo: 0002062-61.2025.8.16.0019

Segundo o relator, desembargador Gamaliel Seme Scaff, o recurso era “imprestável” e sugeria duas hipóteses igualmente graves: tentativa de indução ao erro ou zombaria do colegiado. O julgamento não apenas rejeitou a peça, como reforçou um princípio essencial:

É dever do advogado revisar e validar tudo aquilo que apresenta nos autos — inclusive quando utiliza IA como apoio.

Este caso não é um ataque à tecnologia, mas sim um chamado à consciência profissional. Ferramentas como ChatGPT, Gemini ou similares não substituem a leitura crítica, o estudo das fontes e a boa-fé processual. Quando mal utilizadas, podem comprometer não só a causa do cliente, mas também a imagem e a credibilidade de toda a advocacia.

Estamos vivendo a era da advocacia digital, e isso nos impõe novos desafios deontológicos. É preciso aprender a usar a IA como aliada — nunca como muleta —, mantendo a integridade e a técnica como pilares da atuação jurídica.